Tópicos Especiais¶

Os Tópicos Especiais em Engenharia de Redes Neurais Artificiais abrangem áreas emergentes e fundamentais para a evolução e aplicação das redes neurais no mundo real. Entre esses tópicos estão o Deep Reinforcement Learning, que combina aprendizado profundo com aprendizado por reforço para resolver problemas complexos que envolvem tomadas de decisão sequenciais, como controle robótico e jogos. Também estão os Sistemas de Recomendação Profundos, que utilizam redes neurais para personalizar recomendações de conteúdo em escala, sendo essenciais em plataformas de streaming e e-commerce. O Meta-Learning, ou aprendizado sobre aprendizado, visa tornar os modelos capazes de aprender rapidamente com poucos dados, destacando-se em cenários de aprendizado eficiente. Finalmente, a Confiabilidade em IA levanta questões fundamentais sobre o impacto do uso de redes neurais na sociedade, como discriminação algorítmica, transparência e responsabilidade, aspectos cruciais para o desenvolvimento de soluções mais justas e seguras.

Diferentes Aplicações de Redes Neurais Artificiais¶

As Redes Neurais Artificiais têm aplicações variadas em diferentes domínios, impulsionadas por sua capacidade de aprender padrões complexos em grandes volumes de dados.

Deep Reinforcement Learning¶

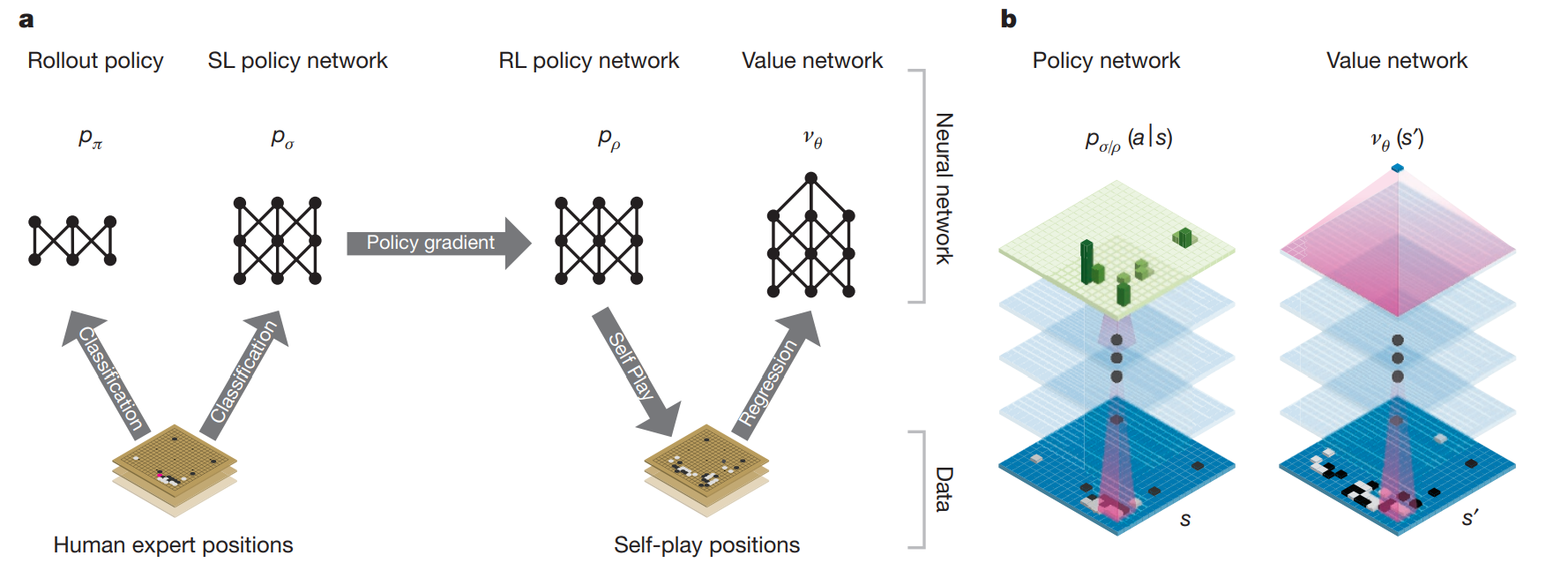

Deep Reinforcement Learning (DRL) é uma abordagem que combina redes neurais profundas com algoritmos de aprendizado por reforço, permitindo que agentes inteligentes aprendam a tomar decisões em ambientes complexos e dinâmicos. Nessa técnica, o agente interage com o ambiente, recebendo recompensas ou penalidades com base em suas ações, e usa esse feedback para ajustar suas políticas de decisão, maximizando recompensas a longo prazo. A introdução de redes neurais profundas permite que o DRL lide com estados e ações de alta dimensão, superando limitações de abordagens tradicionais de reforço. Aplicações de DRL incluem desde o desenvolvimento de agentes que dominam jogos como Go (Silver et al., 2016) e StarCraft até controle em robótica, sistemas autônomos, e otimização de processos em setores como saúde e finanças, onde as decisões são tomadas em cenários incertos e em tempo real.

O artigo “A survey on deep learning and deep reinforcement learning in robotics with a tutorial on deep reinforcement learning” oferece uma visão geral das principais abordagens e avanços no uso de deep learning e deep reinforcement learning (DRL) aplicados à robótica. Ele destaca como essas técnicas têm se mostrado eficazes para resolver tarefas complexas, oferecendo uma maneira natural de desenvolver pipelines de ponta a ponta, que vão desde a percepção sensorial até a ação, passando pela geração de políticas para execução das tarefas. O artigo também explora como essas abordagens conseguem lidar com desafios do mundo real, como ruído nos sensores, imprecisões na atuação e variabilidade dos cenários. Além disso, o artigo fornece um tutorial sobre os principais conceitos e algoritmos de DRL, abordando como essas técnicas têm sido aplicadas a diversas áreas da robótica, como navegação de robôs móveis, planejamento de movimento e manipulação robótica

Deep Recommender Systems¶

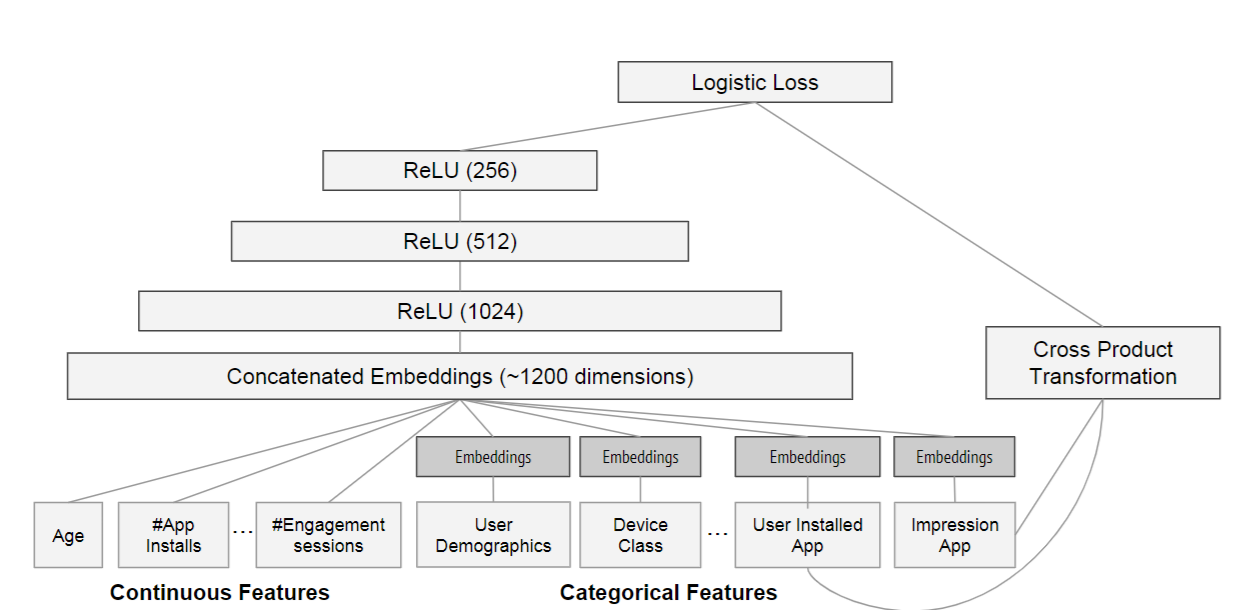

Deep recommender systems são uma evolução dos sistemas de recomendação tradicionais, aproveitando o poder do deep learning para melhorar a qualidade e precisão das recomendações (D’au et al., 2020; Cheng et al., 2016). Esses sistemas têm sido amplamente explorados para resolver desafios como o cold start e a escassez de dados, problemas comuns em abordagens tradicionais como collaborative filtering e content-based filtering. Ao utilizar redes neurais profundas, os deep recommender systems são capazes de aprender representações mais ricas e complexas das interações usuário-item, proporcionando recomendações personalizadas e mais precisas. Aplicações em domínios como streaming de vídeo, e-commerce e redes sociais têm demonstrado o sucesso dessas abordagens, com modelos como autoencoders, redes convolucionais (CNN) e redes recorrentes (RNN) sendo os mais populares, especialmente pela sua capacidade de capturar padrões e dependências temporais e contextuais nas preferências dos usuários.

Aprendendo a Aprender¶

Aprender a aprender é o conceito de desenvolver a capacidade de adquirir novas habilidades ou conhecimento de maneira mais eficiente com o tempo. Em vez de apenas memorizar informações ou executar uma tarefa de forma isolada, essa abordagem busca aprimorar a flexibilidade cognitiva, permitindo que um sistema (ou uma pessoa) aprenda padrões e estratégias que podem ser aplicados a novos contextos e problemas. No campo da inteligência artificial, essa ideia se traduz em criar modelos que possam generalizar o aprendizado para novas tarefas com poucos exemplos, acelerando o processo de adaptação. Um dos principais desdobramentos dessa ideia em IA é o meta-learning, que se concentra em treinar modelos para aprender novas tarefas de forma rápida e eficiente, explorando experiências anteriores e extraindo princípios gerais para enfrentar novos desafios.

Meta-Learning¶

Meta-learning, ou “aprendizado sobre o aprendizado”, é uma abordagem que busca ensinar modelos de inteligência artificial a aprender de forma mais eficiente a partir de poucas experiências. Ao contrário de modelos tradicionais, que são treinados para realizar uma única tarefa, o foco do meta-learning é generalizar o processo de aprendizado para várias tarefas diferentes. Isso é feito ao expor o modelo a uma variedade de tarefas durante o treinamento, permitindo que ele identifique padrões de aprendizado que possam ser aplicados a novas tarefas com dados limitados. Um exemplo comum de meta-learning é o uso de algoritmos como MAML (Model-Agnostic Meta-Learning), de Finn et al. (2017), que ajusta os parâmetros do modelo para que ele possa ser rapidamente adaptado a novas situações com poucas atualizações. Essa abordagem é especialmente valiosa em cenários como few-shot learning, onde há pouca disponibilidade de dados para novas classes, mas o modelo consegue aprender com eficiência usando o conhecimento acumulado de tarefas anteriores. Meta-learning é, portanto, uma ferramenta poderosa para melhorar a adaptabilidade e eficiência de sistemas de IA, tornando-os mais robustos em ambientes dinâmicos e diversos.

Confiabilidade em Sistemas de IA¶

Confiabilidade em sistemas de Inteligência Artificial (IA) vai além de desempenho técnico, envolvendo também aspectos críticos como transparência, ética e interpretabilidade. A transparência refere-se à clareza com que as decisões de um sistema de IA podem ser entendidas por humanos, permitindo que usuários e desenvolvedores saibam como os modelos chegaram a uma determinada conclusão. Isso é crucial para a identificação de possíveis vieses e injustiças, que podem surgir se a IA for treinada em dados desbalanceados ou refletir preconceitos existentes. A interpretabilidade, por sua vez, torna os modelos mais acessíveis, permitindo que suas operações internas sejam compreendidas, em vez de funcionarem como “caixas-pretas”. Além disso, a ética na IA está ligada à responsabilidade no uso desses sistemas, garantindo que sejam desenvolvidos e implementados de forma justa, transparente e segura, respeitando a privacidade dos dados e os direitos dos indivíduos. Focar nesses aspectos é essencial para que os sistemas de IA sejam confiáveis e aceitos pela sociedade, promovendo uma adoção responsável e justa da tecnologia.

Ética¶

A ética em Inteligência Artificial (IA) trata dos desafios e dilemas relacionados ao uso responsável dessas tecnologias, assegurando que elas sejam desenvolvidas e aplicadas de maneira justa, transparente e segura, sem prejudicar direitos fundamentais. Questões como viés algorítmico, privacidade de dados, responsabilidade nas decisões automatizadas e impacto social são temas centrais. Trabalhos importantes nessa área incluem os princípios de design ético propostos por pesquisadores como Timnit Gebru (e.g. Raji et al., 2020) e Kate Crawford (e.g. Crawford & Calo, 2016), que enfatizam a necessidade de mitigar preconceitos e garantir justiça nos modelos de IA. Além disso, o estudo de algoritmos justos de Cynthia Dwork (e.g. Dwork et al., 2012) e o desenvolvimento de frameworks de IA explicável (XAI) por estudiosos como David Gunning (e.g. Gunning et al., 2019)são referências no avanço da transparência e da justiça em IA. Esses trabalhos ajudam a criar diretrizes que buscam uma IA mais alinhada com os valores éticos, promovendo maior responsabilidade e confiança na adoção da tecnologia.

Transparência¶

Transparência em sistemas de Inteligência Artificial (IA) refere-se à capacidade de tornar visível e compreensível o funcionamento interno dos algoritmos, modelos e processos de tomada de decisão (Lipton, 2018). Em um sistema transparente, os usuários e desenvolvedores têm acesso a informações detalhadas sobre os dados usados para treinar os modelos, as etapas de processamento e os critérios que influenciam as decisões. Isso é essencial para aumentar a confiança nos sistemas de IA, possibilitando a identificação de erros, preconceitos ou inconsistências. A transparência também contribui para a responsabilização, permitindo que os envolvidos possam auditar e revisar as decisões do sistema, além de oferecer uma base para regulamentos éticos que promovam o uso justo e seguro da IA. A busca por transparência é fundamental em setores sensíveis, como saúde, justiça e finanças, onde decisões automáticas podem ter um impacto significativo na vida das pessoas.

Interpretabilidade¶

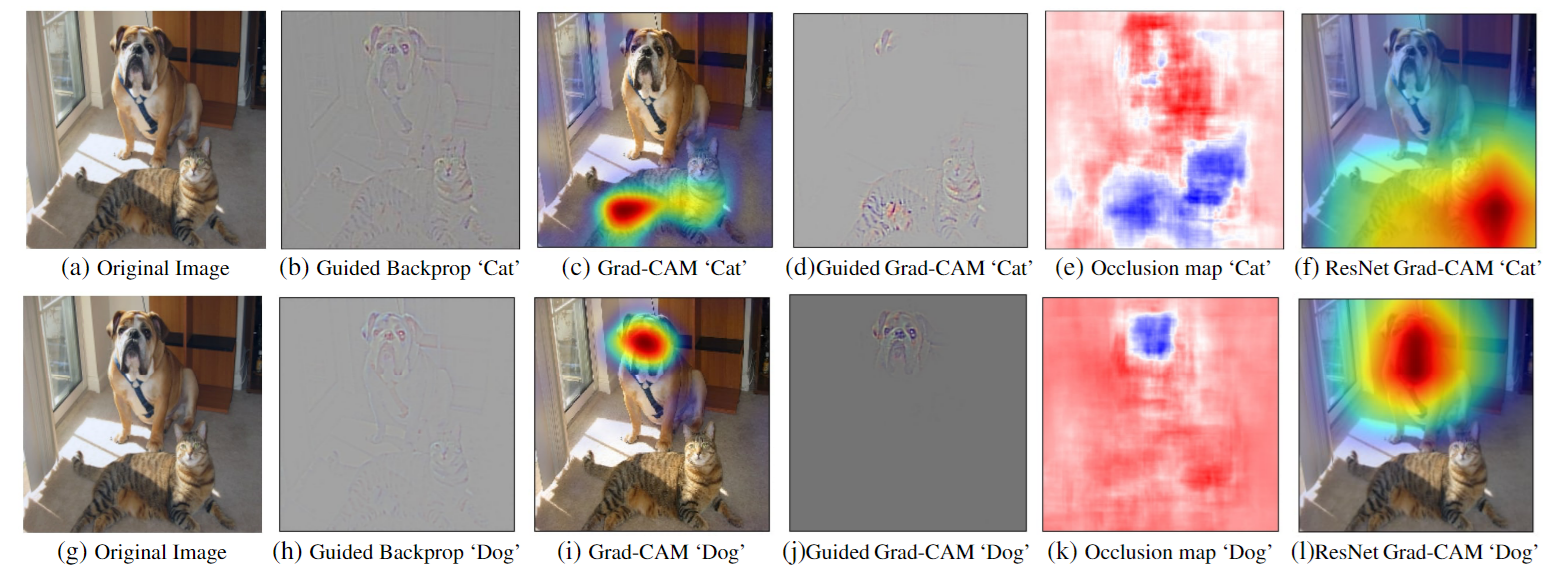

Interpretabilidade em Inteligência Artificial (IA) refere-se à capacidade de compreender e explicar como um modelo toma decisões ou faz previsões, permitindo que seus resultados sejam entendidos por humanos (Lipton, 2018). Em modelos interpretáveis, como árvores de decisão ou regressões lineares, é possível rastrear claramente a contribuição de cada variável para o resultado final. No entanto, em modelos mais complexos, como redes neurais profundas ou modelos baseados em aprendizado profundo, a interpretabilidade se torna um desafio, já que os processos internos são menos transparentes e mais difíceis de explicar de forma intuitiva. A importância da interpretabilidade reside na necessidade de confiança e responsabilização, especialmente em áreas críticas como saúde, finanças e justiça, onde decisões automáticas podem impactar a vida das pessoas. Ferramentas e técnicas como LIME, SHAP e Grad-CAM foram desenvolvidas para melhorar a interpretabilidade de modelos complexos, fornecendo explicações locais e globais sobre as previsões, promovendo assim maior aceitação e segurança no uso de IA (Gomex & Mouchère, 2023).

Considerações Finais¶

Além da confiabilidade, exploramos temas centrais em Inteligência Artificial (IA), como meta-learning, reinforcement learning e recommender systems. Essas áreas trazem avanços significativos na capacidade de adaptação e aprendizado dos sistemas de IA, ampliando suas aplicações em diversos setores. O meta-learning permite que os modelos aprendam a se adaptar rapidamente a novos cenários com poucos dados, enquanto o reinforcement learning habilita a tomada de decisões baseadas em recompensas, fundamentais em áreas como robótica e jogos. Já os recommender systems são essenciais para personalização de conteúdo e recomendações em plataformas digitais. Ao compreender esses temas, podemos avançar no desenvolvimento de sistemas de IA mais robustos, eficientes e adaptáveis, sempre considerando questões éticas e práticas que garantam seu uso responsável.

Referências¶

Morales, E. F., Murrieta-Cid, R., Becerra, I., & Esquivel-Basaldua, M. A. (2021). A survey on deep learning and deep reinforcement learning in robotics with a tutorial on deep reinforcement learning. Intelligent Service Robotics, 14(5), 773-805.

Silver, D., Huang, A., Maddison, C. J., Guez, A., Sifre, L., Van Den Driessche, G., ... & Hassabis, D. (2016). Mastering the game of Go with deep neural networks and tree search. nature, 529(7587), 484-489.

Da’u, A., & Salim, N. (2020). Recommendation system based on deep learning methods: a systematic review and new directions. Artificial Intelligence Review, 53(4), 2709-2748.

Cheng, H. T., Koc, L., Harmsen, J., Shaked, T., Chandra, T., Aradhye, H., ... & Shah, H. (2016, September). Wide & deep learning for recommender systems. In Proceedings of the 1st workshop on deep learning for recommender systems (pp. 7-10).

Finn, C., Abbeel, P., & Levine, S. (2017, July). Model-agnostic meta-learning for fast adaptation of deep networks. In International conference on machine learning (pp. 1126-1135). PMLR.

Raji, I. D., Smart, A., White, R. N., Mitchell, M., Gebru, T., Hutchinson, B., ... & Barnes, P. (2020, January). Closing the AI accountability gap: Defining an end-to-end framework for internal algorithmic auditing. In Proceedings of the 2020 conference on fairness, accountability, and transparency (pp. 33-44).

Crawford, K., & Calo, R. (2016). There is a blind spot in AI research. Nature, 538(7625), 311-313.

Dwork, C., Hardt, M., Pitassi, T., Reingold, O., & Zemel, R. (2012, January). Fairness through awareness. In Proceedings of the 3rd innovations in theoretical computer science conference (pp. 214-226).

Gunning, D., Stefik, M., Choi, J., Miller, T., Stumpf, S., & Yang, G. Z. (2019). XAI—Explainable artificial intelligence. Science robotics, 4(37), eaay7120.

Lipton, Z. C. (2018). The mythos of model interpretability: In machine learning, the concept of interpretability is both important and slippery. Queue, 16(3), 31-57.

Gomez, T., & Mouchère, H. (2023). Computing and evaluating saliency maps for image classification: a tutorial. Journal of Electronic Imaging, 32(2), 020801-020801.